Toto je asi nejznámější deepfake video v Česku. Deepfake je technologie, která dokáže dosadit do videa tvář jakékoliv osobnosti. Tak, že je téměř nerozpoznatelné, že jde o fake. V současnosti je to nejobávanější hrozba ve světě fake news. Kvůli nim přestává platit, co vidím na vlastní oči, to je pravda. Kde se ale vlastně deepfakes vzaly a jak fungují? Čtěte dál. 👇

Kdy se začala metoda deepfake používat?

Deepfakes poprvé přitáhly pozornost na konci roku 2017, když na sociální síti Reddit začalo kolovat zmanipulované pornografické video, ve kterém byla na pornoherečku dosazena tvář herečky Gal Gadot. Autor tvrdil, že vytvořil stroj s algoritmem, který přenáší obličeje celebrit do pornografických videí.

Samotný termín „deepfake“ se pak začal užívat podle názvu subredditu (tedy vláknu, v němž se soustředí obsah se stejným tématem), na kterém byla tato videa sdílena. I když Reddit v roce 2018 toto vlákno zakázal, dalšímu sdílení pornografického obsahu pod heslem deepfake tím nezabránil.

Upravování videí není nic nového. Například v Hollywoodu obličeje ve videích realisticky nahrazovali už dlouho pomocí CGI (speciálních efektů tvořených počítačovou úpravou). Třeba pro části filmů se zemřelými herci. Oproti dnešním deepfakes to ale byla o hodně dražší a pracnější metoda. Díky novým technologiím si kdokoliv s lepším počítačem může vytvořit velmi realistické video.

Co je potřeba k vytvoření deepfake videa?

Odpověď je jednoduchá: obrovské množství fotografií nebo videí. Software z nich rozpozná mimiku člověka a naučené informace o pohybu použije na objekt ve videu. Supasorn Suwajanakorn, počítačový vědec zabývající se deepfakes, vytvořil techniku, díky níž dokáže software rekonstruovat 3D model obličeje, aniž by musel tvář člověka skenovat. Tahle metoda se pak ve videích uplatňuje při každém filmovém snímku.

Důležitým prvkem je i správná imitace originálního stylu řeči a mimiky, které se počítač naučí napodobit z nahrávek dané osobnosti. Potom se uměle vytvoří část kolem úst a dodělají se další detaily a zuby.

Pornografie, satira i filmy

Deepfake videa se šíří obrovskou rychlostí. Jen za poslední rok se jejich počet na internetu zdvojnásobil. Podle studie The State of Deepfakes se jich dnes na internetu objevuje přes čtrnáct tisíc. A rostoucí počet souvisí s tím, že algoritmy k vytváření deepfake videí už využívá spousta počítačových aplikací, služeb a také komunit.

A právě komunity hrají velkou roli v tom, jak rychle se schopnosti a software potřebný k tvorbě deepfake šíří. Deepfake videa se v současnosti z 96 % objevují v pornografii, kde jsou do videí dosazovány nejčastěji oblíbené britské a americké herečky a zpěvačky.

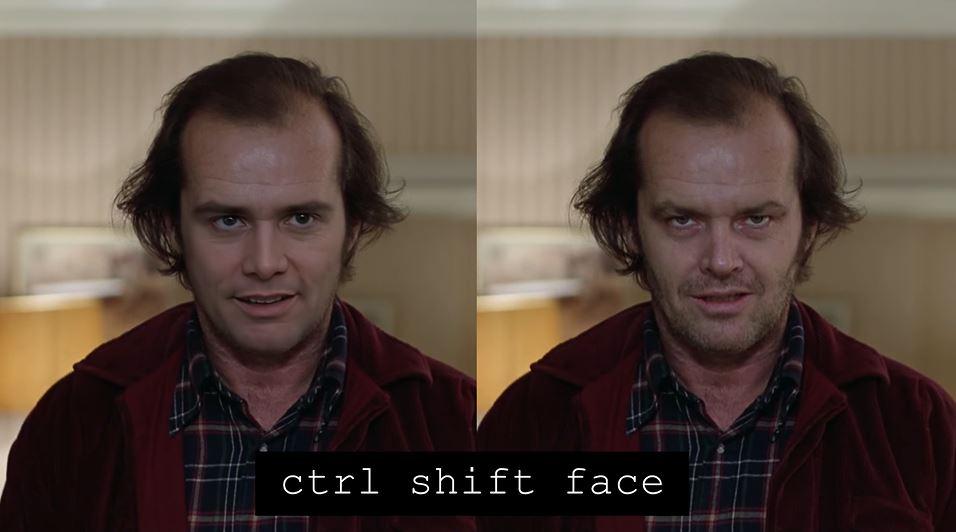

Na deepfake můžeme ale narazit i v satirických videích jako jsou třeba úryvky z filmů, kde jsou původní herci nahrazováni jinými. Možná jste už zaznamenali pár takových výtvorů od slovenského YouTubera Ctrl Shift Face, který pomáhal s již zmiňovanou upoutávkou na seriál Bezvědomí a mezi jeho vývory patří i nedávný virál Home Stallone, upravená verze Sám doma (Home Alone) se Sylvesterem Stallonem, nebo Kubrickovo Osvícení, kde je místo Jacka Nicholsona obličej Jimma Carreyho.

Role deepfakes v politice

Opravdový problém ale nastává, když se deepfakes dostanou do politiky. Paradoxně jeden z nedávných případů, kdy vedly deepfakes k nepokojům na politické úrovni, se vlastně vůbec netýkal deepfakes. Jde o případ gabonského prezidenta, který v roce 2018 na pár měsíců zmizel z veřejného života a když po delší době vláda zveřejnila tradiční novoroční projev hlavy státu, vedlo to k pochybnostem. Jeho nezvyklý vzhled totiž vedl k tomu, že lidé na sociálních sítích, včetně politiků, tvrdili, že video je deepfake. Stačilo málo a podivné vystoupení prezidenta se stalo vodou na mlýn spekulacím, že se vláda snaží zakrýt jeho nemoc nebo smrt. A zašlo to tak daleko, že video využily vojenské jednotky k vyvolání puče proti vládě. Zpětná analýza záznamu ale neukázala žádné znaky toho, že by se jednalo o deepfake. Prezident Gabonu pak od té doby několikrát veřejně vystoupil a vláda v důsledku událostí oznámila, že v srpnu 2018 prodělal mrtvici, což vysvětlilo jeho předchozí neaktivitu.

Gabonský prezident Ali Bongo v novoročním projevu, který byl mylně považovaný za deepfake

Shallow fakes aneb u deepfakes to nekončí…

Na internetu se kromě deepfake vyskytují i takzvaná shallowfake videa, která jsou s nimi někdy mylně zaměňována. Oproti deepfake se ale nejedná o žádnou sofistikovanou technologii. Je to pouhá manipulace buďto jednoduchými střihacími nástroji nebo záměrným vytržením z kontextu.

A zdá se, že k zmanipulování videí se v nedávné době více používají právě tyto jednodušší postupy. Příkladem může být video během voleb ve Velké Británii, za které byla konzervativní strana kritizována, protože bylo sestříháno tak, aby vypadalo, že Keir Starner z labouristické strany nemá žádnou odpověď pro brexit.

Jako další ukázka může sloužit upravené video kongresmanky Nancy Pelosiové, ve kterém byl její proslov zpomalen, tak aby vyzněl, že nezřetelně mumlá. Záznam byl masivně sdílen na sociálních sítích, a to dokonce i samotným americkým prezidentem. V komentářích pak byla politička označována za opilou.

A co s tím?

Shallowfakes a deepfakes se sice šíří čím dál více, naštěstí už se ale objevují i opatření proti nim. Nově chce například Facebook aktivně vyhledávat manipulativní videa a podle stanovených kritérií rozhodovat o tom, zda budou vymazána.

Smazávána budou videa vytvořená s podporou umělé inteligence nebo strojového učení, která zobrazují výroky a činy lidí, které neřekli a neudělali. Do těchto podmínek, které Facebook stanovil, ale například nezapadá právě zmiňované video Nancy Pelosiové, které dodnes na Facebooku koluje a vyvolává to kritiku.

Například v USA proti zneužívání technologie deepfake postupuje organizace AI Foundation, která přišla s projektem Reality Defender. Ten má analyzovat a ověřovat, zda je obsah týkající se amerických prezidentských voleb v letošním roce nepravý, manipulativní či originální. Činí tak díky technologiím umělé inteligence i lidské kontrole.

Co si z toho všeho odnést?

Deepfake videa jsou na vzestupu, software je stále přístupnější a komunita tvůrců se rozšiřuje. A je dobré počítat s tím, že bude hůř. Zmanipulovaná pornografie představuje sama o sobě velký problém. Teď si musíme začít zvykat na neustálé podezření, že projev jakéhokoliv politika může být podvrhem. Kvalita deepfakes se bude pravděpodobně stále zlepšovat, spolu s ní ale snad budou rozvíjet také techniky na jejich rozpoznání. Přesto bychom měli být čím dál více na pozoru a být kritičtější nejen u textu a fotek, ale i u videí.

Autorka: Zuzana Zavadilová

Zdroje:

Ajder, Henry, Patrini Giorgio, Cavali Francesco, Cullen Laurence. 2019. The State of Deepfakes: Landscape, Threats, and Impact.

DIXON JR. (RET.), Judge herbert b. Deepfakes: More Frightening Than Photoshop on Steroids. Judges‘ Journal. 2019. ISSN 00472972.

Fendrychová, Simona. 2019. Ukazuji, co je možné. Slovák vytváří deep fake videa a varuje před šířením lží https://magazin.aktualne.cz/kultura/film/deep-fake-ctrl-shift-face-hbo/r~fd79df18047811eab259ac1f6b220ee8/

Hernz, Alex. 2020. Facebook bans ‚deepfake‘ videos in run-up to US election https://www.theguardian.com/technology/2020/jan/07/facebook-bans-deepfake-videos-in-run-up-to-us-election

Reality Defender. https://rd2020.org/

Sedláček, Štěpán. Facebook bude mazat upravená a manipulativní videa. Chce tak bojovat proti deepfakes https://www.irozhlas.cz/zivotni-styl/spolecnost/facebook-deepfakes-videa-mazani_2001071824_pj?fbclid=IwAR0wtCtHoT2u9cPQC2rjTht9w40AAGDjAZ0k4Y7NopGCTyWOlLYJUJ3rzbk

Supasorn Suwajanakorn. 2018. Fake videos of real people and how to spot them. https://www.ted.com/talks/supasorn_suwajanakorn_fake_videos_of_real_people_and_how_to_spot_them?fbclid=IwAR2wJLaC0T3FI7eDIOMQzoXRAGNiqlqdvnKPJP9eTrkxE72WycnMablDgaI#t-386371

Rise of the deepfakes. 2018. https://theweek.com/articles/777592/rise-deepfakes

Benjamin Goggin. 2019. From porn to ‚Game of Thrones’: How deepfakes and realistic-looking fake videos hit it big. https://www.businessinsider.com/deepfakes-explained-the-rise-of-fake-realistic-videos-online-2019-6#the-term-deepfake-originated-from-a-reddit-user-who-claims-to-have-developed-a-machine-learning-algorithm-that-helped-him-transpose-celebrity-faces-into-porn-videos-1